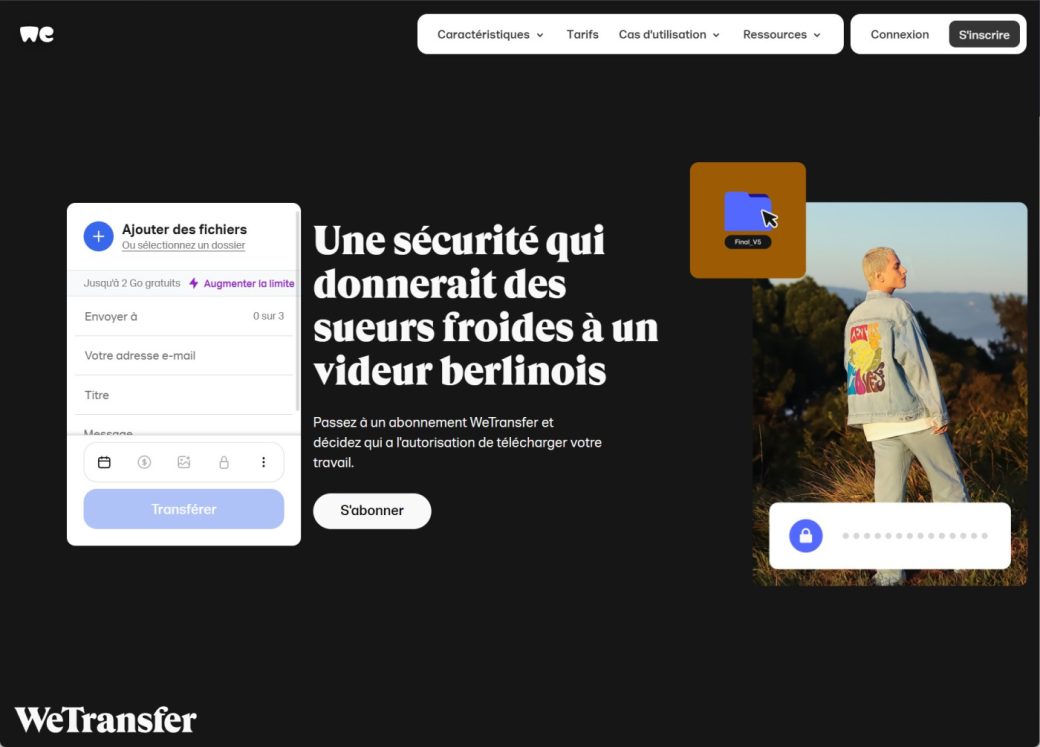

La confiance, c’est un capital fragile. Et quand on est une plateforme comme WeTransfer, utilisée par plus de 80 millions d’utilisateurs dans le monde, il suffit d’un glissement dans les conditions d’utilisation pour faire trembler toute une communauté.

Depuis plusieurs jours, le service de transfert de fichiers fait face à une polémique grandissante autour de l’utilisation possible des fichiers partagés pour entraîner une intelligence artificielle. Une controverse qui intervient dans un climat déjà tendu, où les grandes plateformes numériques doivent justifier chaque ligne de leurs CGU. Ce 15 juillet, WeTransfer a finalement réagi publiquement pour tenter d’éteindre l’incendie.

Des conditions d’utilisation floues qui sèment le doute

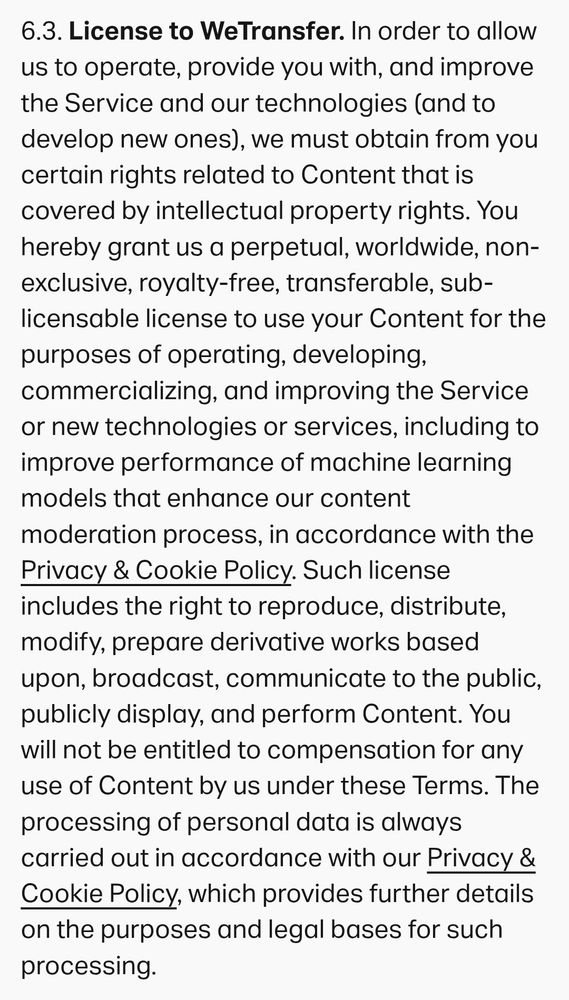

Tout a commencé par la mise à jour des conditions générales de WeTransfer, dans lesquelles certains utilisateurs ont relevé une formulation ambiguë laissant entendre que les fichiers transférés pouvaient être utilisés à des fins d’entraînement d’une IA. Rapidement, la rumeur enfle sur X et LinkedIn, avec des créateurs, designers et agences exprimant leur inquiétude quant à la confidentialité de leurs contenus.

Ce n’est pas la première fois qu’une plateforme se retrouve prise dans ce type de tourmente. Plus tôt cette année, Meta avait déjà provoqué une vague d’indignation en annonçant vouloir utiliser les contenus publics de Facebook et Instagram pour nourrir ses modèles d’IA. Dans ce contexte, WeTransfer n’échappe pas au soupçon généralisé autour de l’utilisation opaque des données personnelles et créatives.

Même sans preuve de revente à des acteurs comme OpenAI ou Google, l’absence de clarté a suffi à provoquer un véritable malaise. D’autant que les derniers chiffres disponibles évoquent plus de 755 millions de fichiers transférés en 2021 sur la plateforme. Un volume qui attire forcément les convoitises dans un marché de l’IA générative en pleine effervescence.

Une prise de parole tardive mais nécessaire

Face à la pression, WeTransfer a dû clarifier sa position. Dans une interview accordée à la BBC le 15 juillet, un porte-parole de l’entreprise a affirmé que l’intelligence artificielle serait utilisée uniquement pour la modération des contenus. L’entreprise insiste : aucun fichier utilisateur n’est partagé avec des tiers ni utilisé pour entraîner des IA commerciales.

LIRE AUSSI : Face à l’IA, les agences doivent réinventer leur modèle pour survivre

La mise à jour des CGU a été reformulée et les conditions (notamment la clause 6.3) entreront en vigueur le 8 août, laissant aux utilisateurs le temps de prendre connaissance des nouveaux termes. Une démarche qui tente de calmer les esprits, sans pour autant éteindre toutes les inquiétudes. Car dans l’écosystème numérique de 2025, la transparence ne peut plus être une réaction, elle doit être une anticipation.

Ce que ça dit du climat autour de la data et de l’IA

Ce nouvel épisode chez WeTransfer illustre bien la sensibilité actuelle autour de la donnée, en particulier chez les créatifs, les agences, les studios et les indépendants. Depuis les débuts de ChatGPT, les plateformes numériques sont scrutées à la loupe, et chaque usage de l’IA soulève des questions éthiques, commerciales et légales.

Aujourd’hui, il ne suffit plus d’offrir un service utile. Les utilisateurs attendent des garanties concrètes, des CGU lisibles, et des engagements clairs sur la souveraineté de leurs données. Dans ce contexte, la moindre ambiguïté peut entacher des années de capital confiance. WeTransfer, plateforme historiquement neutre et fonctionnelle, vient de l’apprendre à ses dépens.

Conclusion

À l’heure où l’IA redéfinit les usages numériques, les acteurs de la tech doivent plus que jamais jouer la carte de la clarté. La polémique autour de WeTransfer rappelle que les données des utilisateurs ne sont plus un simple enjeu technique, mais un marqueur de crédibilité. Reste à voir si la plateforme saura en tirer les leçons pour renouer durablement avec sa communauté.

LIRE AUSSI : OpenAI envisage les pubs dans ChatGPT pour monétiser son IA